SF を信じるなら、ウェアラブルの未来は常にこうなっています。拡張現実。 Apple は、「Apple Glass」と呼ばれるウェアラブル ヘッドアップ ディスプレイによって、その未来の実現にかなり近づいている可能性があります。

Appleがレンズ上に情報を表示する洗練されたメガネを発売するまでには長い道のりがある。バッテリー電源に依存するコンピューティング デバイスでありながら、軽量である程度スタイリッシュである必要があります。

Apple がそのような製品を実現できるまでにはしばらく時間がかかるかもしれませんが、アップルビジョンプロそれはその方向への第一歩です。のビジョンOSプラットフォームとヘッドセットは、Apple の空間コンピューティングへの取り組みの一環です。

ここ数カ月間、Apple の複合現実ヘッドセットに関する噂が集中しているため、以下の内容の多くは 2020 年から 2022 年の間に共有された情報に基づいています。Apple が Vision Pro を発表したことで、最終的な AR 製品がどのようなものになるのかがより簡単にわかります。

ウェアラブルARグラスに関する噂は何年もあったが、2020年までリークされた有用な情報はほとんどなく、それはグラスに関するものではなかったかもしれない。特許出願はこれまでで最高の情報源であり、Apple ヘッドセットの有望な機能がいくつか示されています。

Apple Vision Pro は完全な AR メガネへの第一歩です

Apple Vision Pro は完全な AR メガネへの第一歩です

以下の機能は、噂、特許、リークを組み合わせたもので、「Apple Glass」がどのようなものであるかについての私たちの最良の見解を表しています。 Apple の競合他社の多くは、Apple の最終的なヘッドアップ ディスプレイと競合する製品の製造を開始していますが、噂されている Apple 製品の洗練度にはまだ達していません。

現在は Meta となった Facebook は、Valve や PlayStation などの競合他社と並んで、Meta Quest で VR に進出しました。 Apple のヘッドセットとvisionOS は、VR どころか AR でもないが、両方を組み合わせて独自の領域で競合している。ただし、ARプラットフォームにつながることが期待されています。

Apple による Apple Vision Pro のテクノロジーの初期実装は有望ですが、費用、サイズ、重量、容積を考えると、長い道のりが必要であることがわかります。 Apple がシンプルなメガネのセットをリリースすることを妨げるものは何もありませんが、噂では同社がより高い目標を掲げていることが示唆されています。

メガネに至るまで

Apple Glassが存在するには、多くの技術的問題を解決する必要がある。 Apple Vision Pro は、当時の価格帯で達成できる最高のものとして 2024 年に発売されました。

ガラスレンズは最終的には付属品ではなく製品全体になる可能性がある

ガラスレンズは最終的には付属品ではなく製品全体になる可能性がある

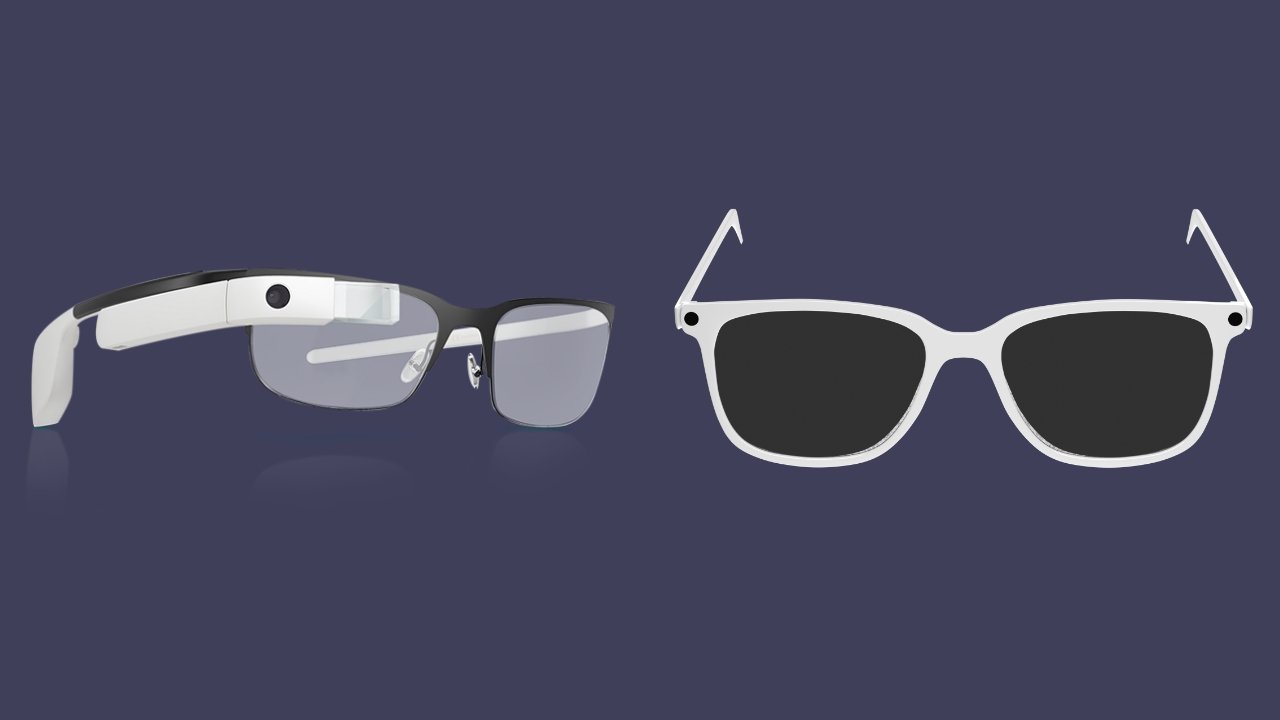

競合他社は AR インターフェイスを備えたシンプルなウェアラブル グラスを提供していますが、これらは基本的に小型のプロジェクターであり、真の AR に期待される未来的なディスプレイではありません。 Google Glass は可能なことのヒントであり、Apple は今日そのようなものを構築することができますが、Apple Watch を手首に装着しても意味がありません。

透明 OLED テレビは最近テクノロジー分野に参入しました。このテクノロジーは、真の AR メガネを可能にするものの一部です。ディスプレイをウェアラブルな状態まで小型化するには何年もかかります。

AR の現在のソリューションは単純にパススルーです。カメラが世界を捉え、それをユーザーの目から数インチ離れた小さなディスプレイに表示します。これが、Apple Vision Pro がゴーグルではなくヘッドセットである理由です。これを機能させるには分離が必要です。

真の AR は孤立しません。情報や表示が世界の一部であるかのように見えます。 visionOS はこれを念頭に置いて構築されています。

Apple がこの技術的限界に達することができれば、それはおそらくウェアラブル技術にとって革命となるでしょう。そして、ローンチ時にはすでにプラットフォームとApp Storeが準備されているでしょう。

Meta Orion は通常の仕様として合格することを望んでいる AR グラスです

Meta Orion は通常の仕様として合格することを望んでいる AR グラスです

5 年間の極秘開発を経て、Meta はプロジェクター技術を応用した Orion メガネのプロトタイプを発表しました。 UI は Apple Vision Pro や Meta Quest のフローティング ウィンドウに似ていますが、真の拡張現実で見られます。

プロジェクターは 2024 年に仕事を成し遂げるための良い手段ではありますが、Apple がその道を進む可能性は低いように思えます。さらに、Orion にはリストバンドと、Apple Watch や iPhone と簡単に交換できる外部コンピューティング ユニットが必要です。

アップルインテリジェンスApple Glassを実用的な製品にする上で重要な役割を果たす可能性がある。自然な音声制御、環境理解、音声認識、翻訳機能はすべて、ML の代わりに AI を使用することで高速化されます。

初期の不正確な噂

ジョン・プロッサー2020年6月のリークでは、メガネの初期のプロトタイプを見たと主張し、それを「洗練された」と評した。同氏は2021年のリリースを予想しているが、同年には何も発表されなかった。

噂は5月21日にプロッサー氏から届き、スティーブ・ジョブズ氏が掛けていたものに似せてデザインされた「ヘリテージ・エディション」のメガネが発売されるだろうと述べた。ブルームバーグのマーク・ガーマン氏は、介入して、それまでの噂はすべて虚偽であると言う必要性を感じた。

AppleInsider が何年にもわたって報じているように、Gurman 氏は、2 つの異なるデバイスが存在すると主張しています。1 つはメガネと称され、もう 1 つは VR ヘッドセットであり、これは Apple Vision Pro であることが判明しました。プロッサー氏は、デバイスが 2 つあることには同意するが、ガーマン氏のメガネの 2023 年という長いリリーススケジュールには同意しなかった。

プロッサー氏がメガネの噂についてほぼすべての点で間違っていたことは時間が経てば証明された。彼に漏洩した情報が何であれ、それはApple Vision Proの初期のプロトタイプか製造品である可能性が高いです。

デザイン

実際のデザインの写真はリークされていないが、Apple はこのメガネをファッショナブルで親しみやすいものにしたいと考えていると噂されている。アップルウォッチApple がウェアラブル デザインをどのように扱っているかを調べるのに適した場所です。微妙ではありますが、明らかに技術の一部です。

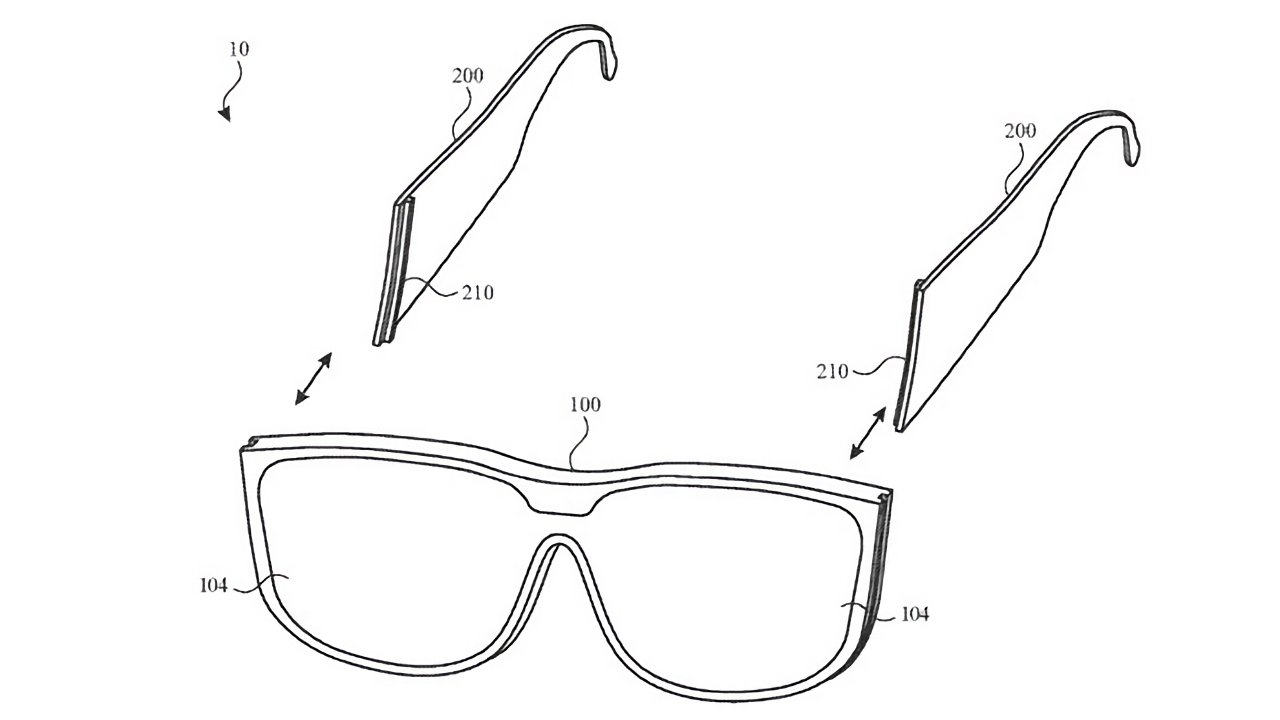

特許に示されているものの多くは安全メガネのように見えますが、これらは特許を説明することを目的としたプロトタイプの図面であり、製品を説明することを目的としたものではありません。最終的には「Apple Glass」は普通のメガネに見えるかもしれないが、より正式な情報が流出するまでは分からない。

AppleのARグラスにはモジュール式部品が含まれる可能性がある

AppleのARグラスにはモジュール式部品が含まれる可能性がある

ユーザーが顔に着けたくなるテクノロジー製品をデザインするのは簡単な作業ではありません。スタイル、色、さらにはレンズの形状が購入の決定を左右しますが、Apple は多くの製品に対して画一的なアプローチで知られる企業です。

ソニーは、Apple ヘッドセット用に解像度 1280x960 のハーフインチ Micro OLED ディスプレイを供給する可能性があります。関係者によると、ディスプレイの注文は2022年上半期までに完了する予定だという。ただし、これらは Apple VR ヘッドセット用である可能性があります。

2020年後半に明らかにされた特許は、ユーザーの視力を改善するために液体を使用してレンズの形状を変形させ、ユーザーの目の前に置かれたレンズを自動的に調整するApple VRまたはARヘッドセットを指摘している。この特許は、接続されたポンプとリザーバーによって膨張させて空にすることができる、中央の流体チャンバーの周囲にある一連のレンズコンポーネントを提案しています。

その後の噂では、Apple メガネの製造の遅れが指摘されました。ある時点で、アナリストのミンチー・クオ氏は、「Apple Glass」は2025年まで完成しない可能性があり、ARコンタクトのセットは2030年の発売に向けて設定されていると述べた。

Vision Pro は大きくて重く、冷却が必要で、外部バッテリー パックで 2 時間しか持続しないため、これらのタイムラインを再度調整する必要がある場合があります。様式化された AR グラスが登場するのは何年も先のようです。

処理能力とバッテリー寿命

ワイヤレス信号、スマートディスプレイ、マイク、強力なプロセッサ、LiDAR を追加すると、大容量のバッテリーが必要なデバイスになります。 Apple が誰もが身に着けたいデバイスを望むのであれば、見た目が良いだけでなく、性能も必要です。巨大なバッテリーと高温のプロセッサだけでは限界があるため、Apple はバランスを見つける必要があるだろう。

Apple が削減できる側面の 1 つは、処理能力です。第一世代の Apple Watch と同様に、スマート グラスはiPhoneすべての処理ニーズに対応し、その情報のみを表示します。

Apple のスマート グラスのペアリングは AirPods と同じくらい簡単であるべきです

Apple のスマート グラスのペアリングは AirPods と同じくらい簡単であるべきです

携帯電話からメガネに情報を中継することで、Apple はローカル処理を大幅に削減し、ディスプレイとセンサーへの電力供給だけを気にする必要がなくなります。これにより、そのような製品のリリースが加速する可能性があるが、2025年はまだ早すぎ、初代Apple Watchと同じ問題を引き起こすことになるだろう。

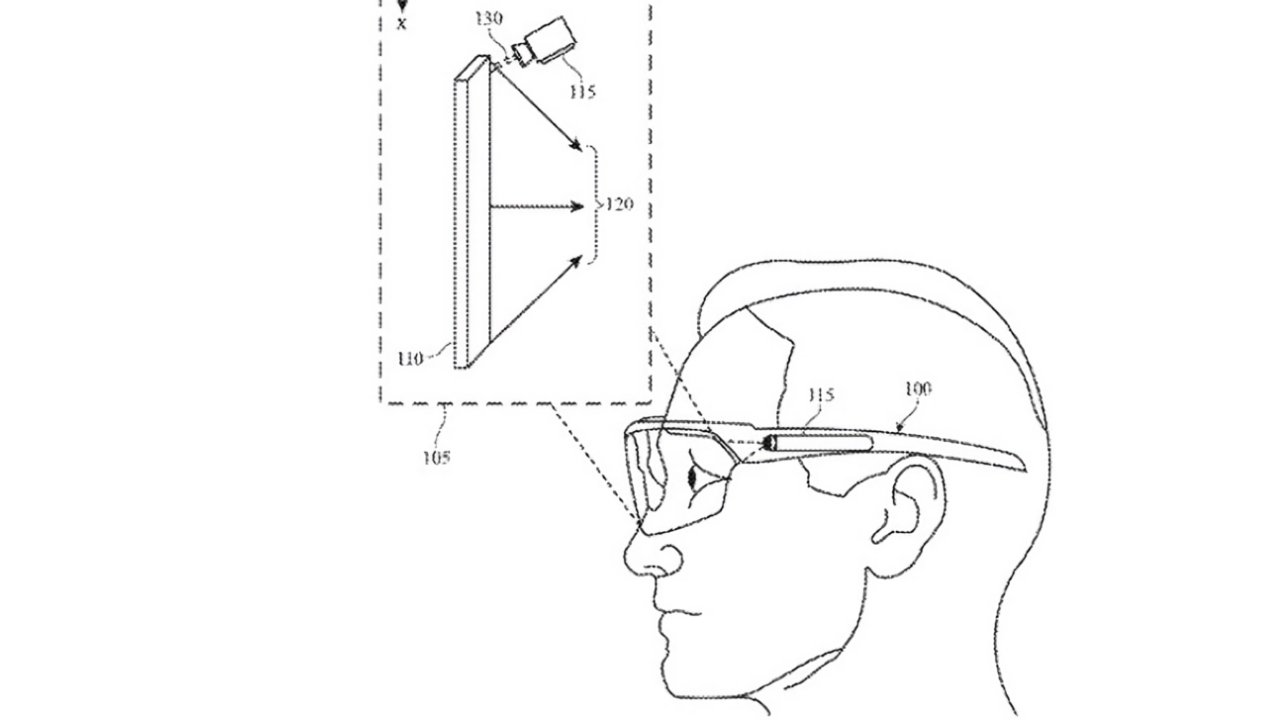

Appleが申請したある特許には、データを処理して「Apple Glass」やVRヘッドセットに情報を転送するために使用できる一連の基地局とIR追跡デバイスが示されている。これらの追跡ツールが専用の基地局にオフロードされることで、ウェアラブルの追跡が向上し、バッテリーの使用量が削減されます。美術館がユーザーを追跡し、すべての作業を基地局が行うことでメガネに関連データを表示できることを考えてください。

ジョニー・アイブはかつて、技術がアイデアに追いつくまで製品の開発が何年も続く可能性があると述べました。 Appleはここでも同じアプローチを取る可能性が高く、技術が成熟するまでの間、内部でARグラスをさまざまなバージョンに開発することになるだろう。

アップルのAirPodsは、バッテリー寿命が長い超小型デバイスの好例です。どんなに小さくても、AirPods Pro、ANC を有効にすると数時間持続します。

メガネは技術とファッションの一部として顧客に提供する必要がありますが、多くの人にとって実際のメガネとして機能する第 3 の機能も提供する必要があります。 Apple は度付きレンズを注文するオプションを提供すると予想されていますが、特許には別のオプションが記載されています。レンズ自体は、着用するユーザーに合わせて調整できます。

プライバシーと「Apple Glass」

Apple は社会的に扱いにくいカメラを避け、LiDAR を使用してユーザーにコンテンツ オーバーレイを表示する可能性があります。 AR メガネは情報をオーバーレイするために環境を理解する必要がありますが、Apple Vision Pro とは異なり、完全なビデオ キャプチャは必要ありません。

Appleはカメラの代わりにLiDARやその他のセンサーに依存する可能性が高い

Appleはカメラの代わりにLiDARやその他のセンサーに依存する可能性が高い

Apple は重複の多い製品を販売する傾向がありますが、iPhone は常に Apple のカメラであり、それは変わりそうにありません。スマートフォンを完全に置き換えることを望んでいるように見えた Google Glass とは異なり、Apple の製品は iPhone のエクスペリエンスを拡張します。

もう 1 つの期待は、着用者だけがメガネのコンテンツを見ることができ、ランダムな通行人があなたのビジネスをのぞき見できないようにすることです。

Appleは認証に「Apple Glass」を利用することも検討している。 iPhone に組み込まれた生体認証を利用するのではなく、ヘッドセットは着用者がデバイスを見ているかどうかを検出し、すぐにロックを解除できます。この機能は、Apple Watchと同様に、初めてメガネを着用するときに着用者を認証した後にのみ機能します。

Vision Pro ヘッドセットは認証に Optic ID を使用しており、これは間違いなく Apple のメガネにも採用されるでしょう。ヘッドセットが動作するには多くのカメラが必要ですが、パススルー用のカメラも必要ですが、透明なガラス レンズには必要ありません。

右舷ユーザーインターフェース

iPhone には、ホーム画面として機能するアイコンのセットである Springboard があります。 Appleのメガネには「Starboard」が付いています。インターフェイス要素はリークされておらず、説明すらされていませんが、Apple はそのアイコンと UI を AR インターフェイスに適合させると想定されています。

ビジョンOSインターフェース

ビジョンOSインターフェース

visionOS が明らかになった今、これが Apple Glass 向けのオペレーティング システムとインターフェイスである可能性があるようです。 2.5D効果のある透明なオブジェクトが非常に印象的です。

このような UI のテストに関するコードが iOS 13 リリース候補で見つかりました。 STARTester コードと、「着用または保持」できるデバイスへの参照が Readme ファイルで見つかりました。ただし、ここから得られるものはそれほど多くありませんが、噂の「Starboard」UI 名を裏付けるものです。

LiDAR センサーを使用すると、コントローラーやマーカーを必要とせずにジェスチャー制御が可能になります。ただし、一部の特許は、Apple がゲームなどのよりインタラクティブな体験のためのコントローラーを開発している可能性があることを示唆しています。

Google Glass(左)はテクノロジーを重視したスタイル

Google Glass(左)はテクノロジーを重視したスタイル

第一世代として、ほとんどのエクスペリエンスは受動的であることが予想されます。これについては Google Glass に注目してください。入ってくるのを期待するiメッセージ、実際の生活に道順が重ねられ、興味のあるポイントが強調表示されます。

これらの体験をガイドするカメラはありませんが、LiDAR と地理位置情報、コンパスの方向、頭の傾き、視線追跡、その他のセンサーは、AR オブジェクトを表示する際の精度を確保するのに大いに役立ちます。

iPhone と Apple Watch は、AR インタラクションのアンカーとして機能する可能性もあります。 AR メガネを通して見ているユーザーだけが表示されているものを見ることができるため、プライバシーが強化されます。

iOSのAR機能は「Apple Glass」の可能性を示す

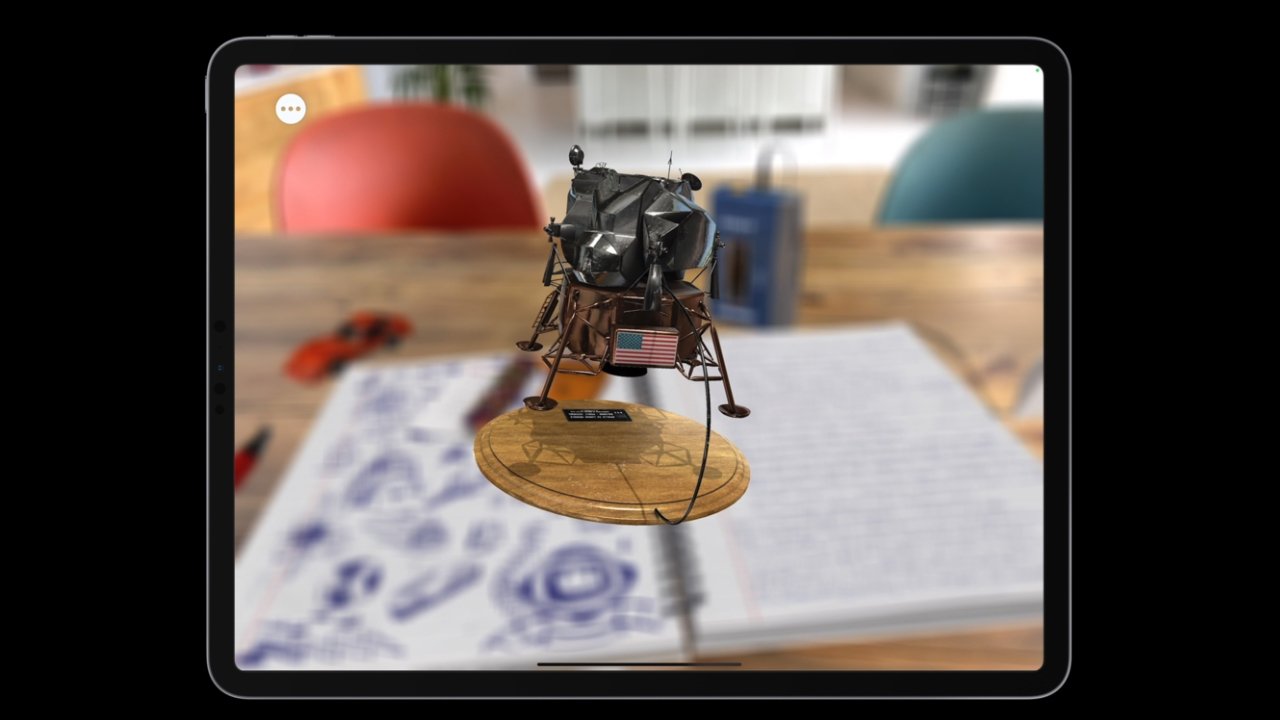

Apple は何年にもわたって拡張現実を推進しており、iOS のバージョンごとに ARKit に新機能が追加されています。これらの構成要素はすべて、「Apple Glass」用に構築されたオペレーティング システムとソフトウェア機能になる可能性があります。

ARKit

ロケーション アンカーを使用すると、開発者とユーザーは現実世界の特定の場所に拡張現実オブジェクトを接続できます。 AR ヘッドセットまたは AR メガネを着用して街を歩き回れば、それ以上の操作を行わずにこれらのオブジェクトを見ることができます。オンデバイスの機械学習は、既知の地図データを使用し、形状を正確に構築することで、オブジェクトを固定できるようになります。

LiDAR により、物理マーカーを使用せずにオブジェクトの位置を迅速かつ簡単に配置できます

LiDAR により、物理マーカーを使用せずにオブジェクトの位置を迅速かつ簡単に配置できます

新しい Depth API は、「Apple Glass」に搭載される可能性のある第 4 世代 iPad Pro の LiDAR システムを活用するために作成されました。取得した深度データと特定のアンカー ポイントを使用して、ユーザーは数秒で場所の 3D マップを作成できます。この機能により、より没入型の AR エクスペリエンスが可能になり、アプリケーションはオブジェクトの配置とオクルージョンの環境をより深く理解できるようになります。

ARKit には顔と手のトラッキングも追加されており、ボディ トラッキングを利用したより高度な AR ゲームやフィルターが可能になります。これは、手話をライブで翻訳したり、レーザータグのようなゲームのために人に AR オブジェクトを添付したりするために使用できます。

アプリクリップ

Apple は噂の App Clips を発表しました。これは、世界中で一部のコマース アプリを使用する際の摩擦を軽減することを目的としています。

App Clip は QR コードなどの画像を使用してコンテンツを表示します。これはウェアラブル AR デバイスに役立つ可能性があります

App Clip は QR コードなどの画像を使用してコンテンツを表示します。これはウェアラブル AR デバイスに役立つ可能性があります

とiOS14, ユーザーは、NFC ステッカーをタップするか、リンクをクリックするか、特別な QR コードをスキャンして「クリップ」にアクセスできます。これらの App Clip はアプリの軽量部分であり、10 MB 未満である必要があり、デバイス上にフローティング カードとして表示されます。そこから、「Apple でサインイン」と「Apple pay」を使用して、アプリをダウンロードすることなく、すぐに取引を完了できます。

ここで最も注目すべきは特殊な QR コードであり、Apple は現在、iPhone の App Clip で使用するためにこれを世界中にばらまいている可能性がありますが、将来的には「Apple Glass」でも使用できるようにするだけです。前提は AR でも同じです。QR コードに近づくと AR オブジェクトが表示され、アプリ全体をダウンロードしなくても操作して購入できます。

HomeKit セキュアビデオ顔認識

ホームキットに追加されたセキュアビデオiOS2019 年には、ビデオに登場するオブジェクトを認識して映像を検索しやすくするなど、いくつかのスマートな機能をユーザーに提供します。 iOS 14では、セキュリティ機能に顔分類機能が追加され、カメラに近づくと個人を識別できるようになります。

写真に保存された顔を使用する HomeKit Secure Video の顔認識は AR メガネ技術の先駆けになる可能性がある

写真に保存された顔を使用する HomeKit Secure Video の顔認識は AR メガネ技術の先駆けになる可能性がある

この機能を実現するには写真アプリの顔認識データが使用されており、Apple はリアルタイムで記録される人物にこのデータを適用しています。 「Apple Glass」にはカメラは搭載されないと予想されているが、人が誰であるかを判断するのに十分なデータを作成できるLiDARやその他のセンサーが搭載される予定だ。

ユーザーが AR ヘッドセットに望んでいた初期の機能の 1 つは、名前や重要な情報を思い出させる即時顔認識です。これ自体には広範囲にわたるプライバシー問題がありますが、データセットがユーザーが iPhone 上に持っているものに限定されていれば、より安全で便利になります。

Apple GlassとiPhone

2008 年に iPhone が発売されて以来、企業は次の目玉を模索してきました。Apple は、Apple Watch や Apple Vision Pro などの製品で自社の成功を超えようと最も懸命に努力している企業の 1 つです。

iPhone 15 プロマックス

iPhone 15 プロマックス

結局のところ、普及性と機能性の点で Apple Glass が実際に iPhone を超えることができるかどうかを知る方法はありませんが、それが最終目標である可能性はあるようです。しかし、iPhone は最終的にそれを確実に超える上で重要な役割を果たすでしょう。

visionOS と Apple Vision Pro の誕生のまさに初期に、Apple はデバイス上でのみ表示できる空間ビデオを記録するツールとして iPhone を宣伝しました。今後のアップデートにより、製品間の関係性がさらに高まる可能性があります。

前述したように、Apple Glass は最初はオフデバイス処理を iPhone に依存する可能性があります。そして、の出現により、アップルインテリジェンス, 製品の初期バージョンでは複雑な操作が iPhone に渡される可能性が十分にあります。

「Apple Glass」の価格と発売日

Apple が空間コンピューティング プラットフォームを発表して以来、Ming-Chi Kuo 氏はリリースのスケジュールを変更しました。焦点はヘッドセットにあり、メガネは何年も前から廃止されています。

Vision Pro は開発者に道を切り開き、第 2 世代のヘッドセットは早くても 2026 年に登場すると予想されています。この 2 番目のモデルはより軽量で、より強力なプロセッサを搭載します。

最終的には、これは AR または MR 体験のために着用できる軽量の「Apple Glass」セットにつながるでしょう。ただし、Apple Vision Pro の制約を考慮すると、リリース時期は 2030 年以降になる可能性があります。価格に関しては、Vision Pro の開始価格が 3,499 ドルであることを考えると天文学的な金額になる可能性がありますが、技術の成熟とサプライチェーンの効率により、数年以内に価格が下がる可能性があります。