拡張現実を作成するツールを作成する作業と並行して、仮想現実Apple は、そのような作品をどのように記録したり、再上映したり、他の人に送信したりできるかについても検討しています。

Apple は拡張現実と仮想現実の両方を作成する方法に取り組んでいます長年にわたって、しかし、新しい特許は録音も検討していることを示しています。 Apple によれば、完全に記録された AR/VR エクスペリエンスは文書化され、後で再生することができます。

ゲームプレイなどのライブ ストリームを録画することはすでに可能ですが、Apple の目標は、コンピュータで生成されたエクスペリエンスの要素と現実世界の要素の両方をキャプチャすることです。

特に拡張現実は、現実世界の環境とデジタル的に追加された要素を組み合わせます。 Apple は、これと、仮想現実とオーディオなどの現実世界のインタラクションの組み合わせを、「コンピューター生成現実コンテンツ」(CGR) または「複合現実」(MR) と呼んでいます。

「既存のコンピューティング システムとアプリケーションは、CGR コンテンツの記録やストリーミングを適切に促進できません。」アップルは言う「コンピュータ生成現実のためのメディア コンポジター」で。

「コンピューターが生成した感覚入力に完全に基づいて設計される VR 環境とは対照的に、複合現実 (MR) 環境は、物理環境からの感覚入力を組み込むように設計されたシミュレート環境を指します」 ... [A] 複合現実環境は、一方の端の完全に物理的な環境ともう一方の端の仮想現実環境の間のどこかにありますが、これは含まれません。」

これは、元のユーザーが見たり行ったりしたものをそのまま伝える Twitch のような受動的なストリームではなく、より没入型の録画を提供できます。

「一部の実装では、従来のビデオ録画技術の画面および音声キャプチャ情報よりも、CGR エクスペリエンスに関する豊富な情報を含む複合ストリームが提供されます」と申請書は続けています。 「合成ストリームには、CGR エクスペリエンスにおける現実または仮想オブジェクトの 3D ジオメトリに関する情報を含めることができます。」

「合成ストリームに現実または仮想オブジェクトの 3D モデルを含めることで、録画またはライブ ストリーミングの視聴者のエクスペリエンスが向上します。たとえば、視聴者が作成者の視点とは異なる視点からシーンを体験したり、オブジェクトを移動または回転したりできるようになります。」 」と書かれています。

Appleのシステムを使えば、そのような録音の視聴者は頭を動かしてさまざまな視点を見ることができるが、「自分の頭の向きや音源に対する相対的な位置などに基づいて音を体験」することもできる。

この特許出願の中核は、デバイス、基本的には十分な処理能力とストレージを備えた任意のコンピューターが要素を個別に、しかし同時にキャプチャする方法についての一連の記述です。その後、それらを再結合して、エクスペリエンス全体を含む「複合ストリームを形成」することができます。

「デバイスは、レンダリングされたフレームを含む最初のデータ ストリームと、追加データを含む 1 つ以上の追加データ ストリームを取得します」と書かれています。 「レンダリングされたフレーム コンテンツ (2D 画像や 3D モデルなど) は、CGR エクスペリエンスでレンダリングされた実際のコンテンツまたは仮想コンテンツを表します...」

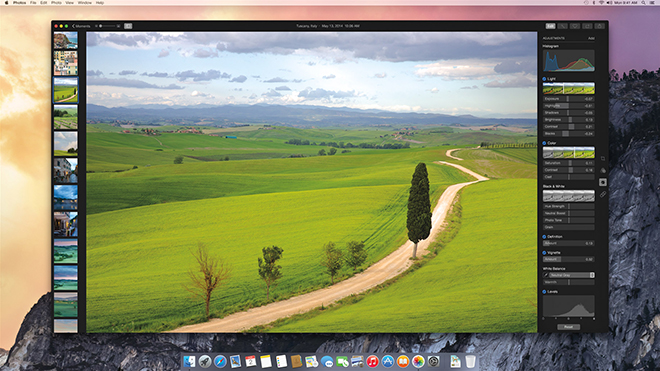

AR/VR エクスペリエンスをどのように記録できるかを説明した特許の詳細

Apple は、これらのストリームを記録するコンピュータを、複数のデータ ストリームを記録して同期を保つことができる「メディア コンポジタ」と呼んでいます。

「メディア コンポジターは、レンダリングされたフレームの最初のデータ ストリームと、追加データの 2 番目のデータ ストリームを取得します」とそれは述べています。 「メディア コンポジターは、レンダリングされたフレーム コンテンツを [タイムスタンプなどの追加データ] と揃える複合ストリームを形成します。」

この特許出願は、Ranjit Desai、Venu M. Duggineni、Perry A. Caro、Aleksandr M. Movshovich、Gurjeet S. Saund の 5 人の発明者によるものです。

Movshovich のこれまでの関連特許には、「入力データストリーム。」